Прямое токование термина корреляция — стохастическая, вероятная, возможная связь между двумя (парная) или несколькими (множественная) случайными величинами.

Выше говорилось о том, что если для двух СВ (X и Y) имеет место равенство

P(XY) =P(X)

P(Y),

P(Y),то величины X и Y считаются независимыми. Ну, а если это не так!?

Ведь всегда важен вопрос — а как сильно зависит одна СВ от другой? И дело в не присущем людям стремлении анализировать что-либо обязательно в числовом измерении. Уже понятно, что системный анализ означает непрерывные выЧИСЛения, что использование компьютера вынуждает нас работать с числами, а не понятиями.

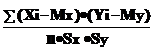

Для числовой оценки возможной связи между двумя случайными величинами: Y(со средним My и среднеквадратичным отклонением Sy) и — X (со средним Mx и среднеквадратичным отклонением Sx) принято использовать так называемый коэффициент корреляции

Rxy=

. {2 - 11}

. {2 - 11}Этот коэффициент может принимать значения от -1 до +1 — в зависимости от тесноты связи между данными случайными величинами.

Если коэффициент корреляции равен нулю, то X и Y называют некоррелированными. Считать их независимыми обычно нет оснований — оказывается, что существуют такие, как правило — нелинейные связи величин, при которых Rxy = 0, хотя величины зависят друг от друга. Обратное всегда верно — если величины независимы, то Rxy = 0. Но, если модуль Rxy = 1, то есть все основания предполагать наличие линейной связи между Y и X. Именно поэтому часто говорят о линейной корреляции при использовании такого способа оценки связи между СВ.

Отметим еще один способ оценки корреляционной связи двух случайных величин — если просуммировать произведения отклонений каждой из них от своего среднего значения, то полученную величину —

Сxy= S (X - Mx)·(Y - My)

или ковариацию величин X и Y отличает от коэффициента корреляции два показателя: во-первых, усреднение (деление на число наблюдений или пар X, Y) и, во-вторых, нормирование путем деления на соответствующие среднеквадратичные отклонения.

Такая оценка связей между случайными величинами в сложной системе является одним из начальных этапов системного анализа, поэтому уже здесь во всей остроте встает вопрос о доверии к выводу о наличии или отсутствии связей между двумя СВ.

В современных методах системного анализа обычно поступают так. По найденному значению R вычисляют вспомогательную величину:

W = 0.5 Ln[(1 + R)/(1-R)] {2 - 12}

и вопрос о доверии к коэффициенту корреляции сводят к доверительным интервалам для случайной величины W, которые определяются стандартными таблицами или формулами.

В отдельных случаях системного анализа приходится решать вопрос о связях нескольких (более 2) случайных величин или вопрос о множественной корреляции.

Пусть X, Y и Z - случайные величины, по наблюдениям над которыми мы установили их средние Mx, My,Mz и среднеквадратичные отклонения Sx, Sy, Sz.